WikiMath

This is Wordpress NewsPaper Theme converted to PmWiki

Presentation Des Reseaux Neuronaux

Présentation

Un neurone artificiel est un modèle de calcul inspirée du fonctionnement d'un neurone biologique. Il agit comme un automate doté d'une fonction de transfert, c.-à-d. un programme qui transforme ses entrées en unique sortie selon des règles précises. Par exemple :

- un neurone additionne ses entrées $x_1$,...,$x_n$

- compare le résultat ($x_1+...+x_n$) à une constante $c$,

- puis émet un signal (+1) si cette somme est supérieure ou égale à ce seuil

($x_1+...+x_n > c$).

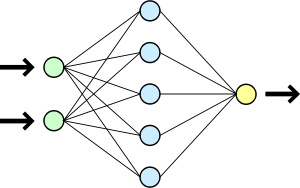

Ces neurones peuvent être associés en réseau qu'on appelle réseau de neurones comme à la figure ci-dessous

Dans cet exemple il ya :

- trois types de neurones (les verts, les bleus, les jaunes) ;

- chaque neurone vert prend une seule entrée (et produit une seule sortie) ;

- chaque neurone bleu prend deux entrées (et produit une seule sortie) ;

- le neurone jaune prend quatre entrées (et produit une seule sortie) ;

- chaque sortie des neurones verts est dupliquée trois fois pour alimenter les neurones bleu

Les réseaux de neurones diffèrent :

- par la topologie du réseau : celui ci peut contenir ou non des cycles

- par leur fonction de transfert : on impose cependant qu'à chaque couche n'apparaissent qu'une seule fonction de transfert

- ...

Application des réseaux de neurones

Ils sont souvent utilisés pour :

- la classification : par exemple pour la classification despèces animales par espèce étant donnée une analyse ADN.

- la reconnaissance de motif (OCR notamment pour le traitement des chèques, par La Poste pour la gestion du code postal)

- approximer des fonction inconnues ou connues mais très complexes

- ...

Historique

- 1943

- Mc Culloch et Pitts présentent le premier neurone formel.

- 1949

- Hebb propose un mécanisme dapprentissage.

- 1958

- Rosenblatt présente le premier réseau de neurones artificiels : le Perceptron. Il est inspiré du système visuel, et possède deux couches de neurones : perceptive et décisionnelle.

Dans la même période, le modèle de l'ADALINE (ADAptive LINear Element) est présenté par Widrow. Ce sera le modèle de base des réseaux multicouches.

- 1969

- Minsky et Papert publient une critique des perceptrons en montrant leurs limites, ce qui va faire diminuer la recherche sur le sujet.

- 1972

- Kohonen présente ses travaux sur les mémoires associatives.

- 1982

- Hopfield démontre lintérêt dutiliser les réseaux récurrents pour la compréhension et la modélisation des fonctions de mémorisation.

- 1986

- Rumelhart popularise lalgorithme de rétropropagation du gradient, conçu par Werbos, qui permet dentraîner les couches cachées des réseaux multicouches.